Anche i pc più vecchierelli possono rivelarsi utili. Tutto sta nel saper adottare alcune soluzioni smart.

Quando un computer comincia a rivelarsi incompatibile a livello di hardware con la maggior parte dei nuovi programmi non bisogna disperare. Innanzitutto si può cercare di aggiornarlo in modo mirato. Non serve cambiare tutto.

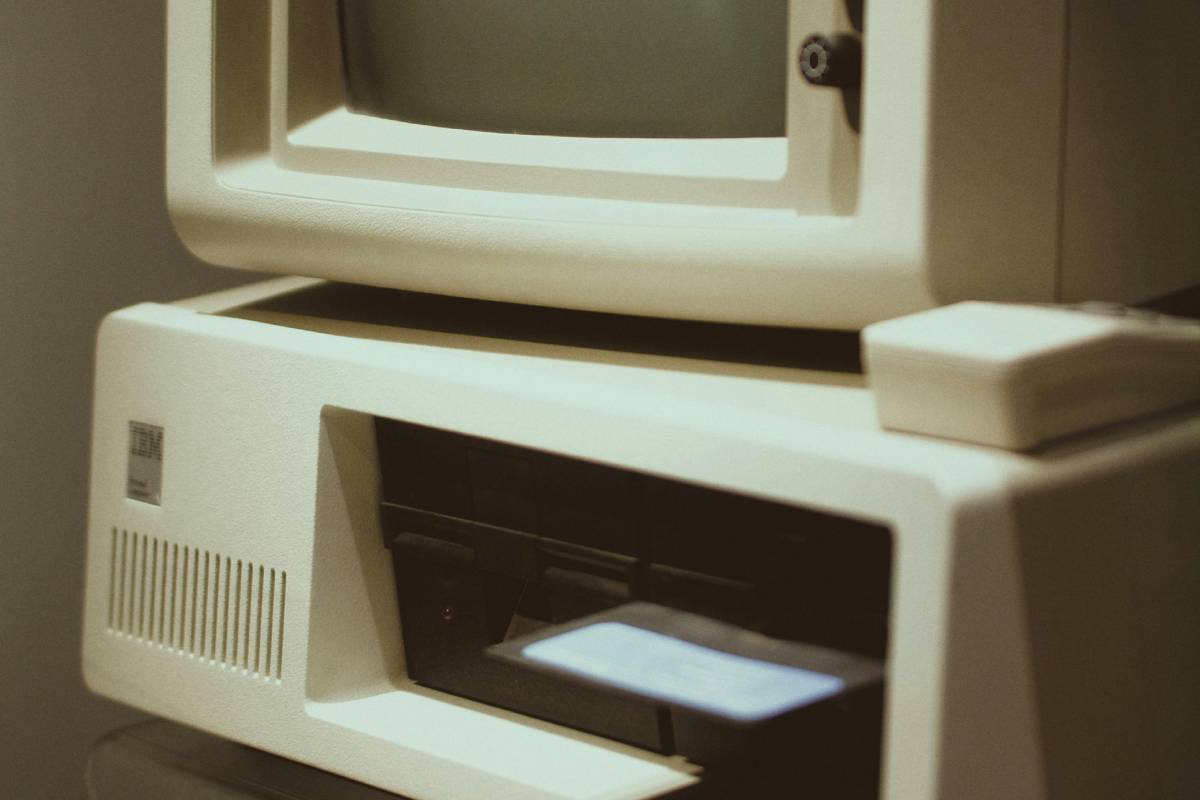

Sui pc più datati, per esempio, si può tranquillamente sostituire l’hard disk meccanico con un SSD. E già questa soluzione può far crescere enormemente la velocità di avvio e risposta. Aggiungere un po’ di RAM può poi dare nuovo smalto al sistema.

L’altra soluzione da adottare è quella di passare a dei sistemi operativi leggeri. Con Windows 11 molti utenti, per esempio, passeranno a Linux. Lubuntu è una soluzione super leggera, ideale per tutti i pc con poca RAM: gira infatti con 512 MB di RAM e un CPU Pentium 4. Xubuntu è altresì una soluzione leggera ma più completa di Lubuntu. Wary Puppy, un sistema leggerissimo, riporterà in attività anche i pc di dieci, quindici anni fa.

Ma non è tutto. Con un vecchio hardware, volendo, si possono anche usare modelli di intelligenza artificiale avanzati direttamente sul proprio computer, anche se non si dispone di hardware all’avanguardia…

La maggior parte dei chatbot AI funziona online, richiedendo una connessione internet. Ma gli utenti che hanno a cuore la loro privacy e che vogliono personalizzare senza costi il chatbot preferiscono sempre l’uso di AI locali.

Il problema è che i modelli AI più potenti richiedono molta memoria e un’enorme potenza di calcolo. Ma con un programma giusto si può eseguire senza problemi un LLM locale anche su un pc datato. Per esempio con CPU Ryzen 5800x e 32 GB di RAM.

AI locale sui vecchi pc grazie ai modelli quantizzati

Il segreto è sfruttare degli LLM quantizzati, ovvero delle versioni compresse dei modelli AI, che usano numeri a bassa precisione. Per esempio 8-bit invece di 32-bit…

Con una AI light si può quindi avere un chatbot potente e personalizzabile in locale, senza connessione, senza costi e senza limiti, pur non potendo sfruttare un grande consumo di memoria e potenza.

Certo, i modelli quantizzati sono leggermente meno precisi di quelli completi, ma sono molto più leggeri e veloci. Il programma giusto per sperimentare questa possibilità è LM Studio. Un’app gratuita, facilissima da installare, che permette di scaricare ed eseguire tantissimi modelli AI localmente.

Con un computer datato si può per esempio scaricare Qwen3-4b-thinking, un LLM sviluppato da Alibaba, con 4 miliardi di parametri. A quel punto basta configurare LM Studio per bilanciare l’uso delle risorse e monitorare il carico sul sistema. E poi sarà possibile usare l’intelligenza artificiale offline anche su un computer con hardware datato.