Bisogna imparare a distinguere un video vero da un video fatto con l’IA. Ma se non riesci a occhio nudo? C’è un trucco che, ironia della sorte, sfrutta propria una IA come cane da guardia dello slop.

Con lo AI slop che galoppa e si insinua su qualunque piattaforma, occorre imparare rapidamente a riconoscere quali sono, almeno per ora, quei piccoli segnali che il contenuto che ci viene mostrato non è un contenuto genuino ma una bufala costruita con l’intelligenza artificiale.

Mentre però in qualità di esseri umani cerchiamo di aguzzare la vista neanche fossimo perennemente dentro la Settimana Enigmistica, i modelli di intelligenza artificiale generativa vengono addestrati e raffinati in modo tale che i loro contenuti diventino sempre più difficili da distinguere.

Per evitare di cadere preda delle bufale occorre quindi, ora più che mai, esercitare una buona dose di scetticismo. E magari usare gli stessi sistemi delle intelligenze artificiali contro di loro. C’è un trucco che ti aiuta a navigare nel nuovo mondo in cui ci hanno trascinato.

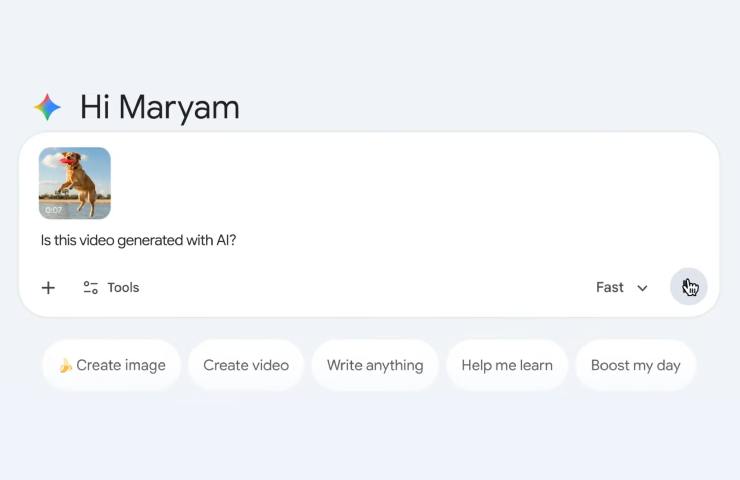

Un trucco che devi conoscere per scoprire se un video è fatto con la IA

Riceviamo il link di un video: ormai la prima cosa da chiedersi è se siamo di fronte a qualcosa di autentico o se non si tratta di una qualche bufala che qualcuno ha deciso di mandare in giro per farsi una risata. I video prodotti dall’intelligenza artificiale hanno ancora alcune piccole idiosincrasie.

Non tutti i modelli sono, per esempio, in grado di gestire bene il passaggio da una scena all’altra e quindi gli errori sono una spia da usare. Ma nella fretta potrebbe essere difficile fermarsi a vedere se ci sono questi errori. Alcuni modelli che producono video aggiungono un marchio, ma basta processare il video per tagliare l’angolo in cui si trova il marchio e il gioco è fatto.

C’è quindi modo di salvarsi? In realtà per almeno una serie di situazioni la risposta è fortunatamente sì. Il modello che per esempio utilizza Google, il famoso nano banana, come pure altri modelli che generano immagini e video, aggiungono una sorta di watermark invisibile chiamato SynthID.

Questo watermark chiaramente non è visibile a occhio nudo ma è possibile chiedere, e qui sta un po’ l’ironia, a Gemini di esaminare il video che ci è stato eventualmente inviato e scoprire se c’è questo watermark. Ma anche il sistema di riconoscimento di Gemini ha i suoi limiti.

L’intelligenza artificiale di Google, infatti, è stata addestrata a riconoscere la presenza del SynthID. Questo significa che non è tecnicamente in grado di dirti se quello che stai guardando è vero oppure no, ma solo di ritrovare, all’interno del codice che compone il video, questo watermark.

Molti altri modelli di intelligenza artificiale generativa non hanno ancora implementato un proprio sistema di riconoscimento. La speranza è che almeno in questo i colossi che stanno distruggendo la nostra vita quotidiana si unifichino.