Obbligo di etichetta per i content creators che usano l’intelligenza artificiale per video sensibili.

Gli algoritmi di intelligenza artificiale stanno permeando a rapida velocità ogni ambito tecnologico e informatico. Nell’industri dei videogiochi rappresentano una specie di terra promessa, come dimostrano gli investimenti sempre più massicci nel settore, ma il web non è da meno con l’implementazione di algoritmi di sicurezza e/o assistenza clienti che iniziano ad affollare social network, store digitali e altre attività online. Ora anche YouTube è in procinto di rivedere le proprie politiche nei confronti dei video che fanno uso di AI generativa senza dichiararlo, specialmente se trattano tematiche di particolare sensibilità. Ecco perché un aggiornamento alle policy della piattaforma preannuncia l’entrata in vigore di un sistema di segnalazione cui tutti i content creator dovranno sottostare. Vediamo i dettagli.

Una policy per etichettarle tutte

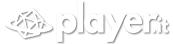

Questa settimana il blog ufficiale di YouTube ha pubblicato un post redazionale nel quale sono state esplicitate la vision aziendale a proposito dei contenuti AI-generated all’interno della piattaforma, e le misure di segnalazione che d’ora in poi sarà necessario adottare per informare gli utenti della loro implementazione da parte dei content creator.

L’AI generativa sta trasformando il modo in cui i creativi si esprimono – dallo storyboard delle loro idee alla sperimentazione con strumenti che coadiuvino il processo creativo. Ma gli utenti richiedono sempre più trasparenza circa la possibilità o meno che i contenuti di cui usufruiscono siano autentici o sintetici. Per questo ragione oggi introduciamo un nuovo strumento all’interno del Creator Studio che richiede ai creativi di segnalare agli utenti quando un contenuto realistico – ovvero un contenuto che possa essere scambiato facilmente per una persona, un luogo o un evento reale – sia in realtà alterato tramite uno strumento sintetico, inclusa l’AI generativa. Non chiediamo ai creativi di segnalare contenuti che sono palesemente irrealistici, animati che utilizzino effetti speciali o che abbiano fatto ricorso all’AI generativa in sede di assistenza alla produzione.

– How we’re helping creators disclose altered or synthetic content – 18 marzo 2024

YouTube insomma sta introducendo un obbligo di segnalazione per tutti quei contenuti che siano stati modificati e/o alterati tramite intelligenza artificiale, e che possano perciò essere scambiati per elementi reali. Per fare un esempio pratico, il compositing del volto di una persona sul corpo di un’altra andrebbe segnalato, qualora questo intervento fosse fatto in modo realistico e dunque indistinguibile da una persona reale. Il discorso cambia quando si ha a che fare con video che palesemente non vogliono essere verosimili, poiché in questo caso si suppone che lo spettatore sia abbastanza scafato e/o consapevole da rendersi conto che sta assistendo a un contenuto di finzione. Dunque niente segnalazioni in casi di contenuti totalmente animati (siano essi disegni i CGI), né video che facciano clamoroso ricorso a VFX (nessuno si aspetta davvero che una persona voli o acquisisca super poteri, ad esempio!). L’obbligo si verificherà solamente nei casi più ambigui, che verosimilmente potrebbero indurre in errore gli spettatori, convinti di stare assistendo a eventi reali.

Ecco alcuni esempi in cui la segnalazione sarà obbligatoria:

- Usare le fattezze di una persona realistica: utilizzare un voice over generato da AI, oppure alterare le fattezze fisiche di una persona tramite algoritmi di AI.

- Alterare immagini di un luogo o un evento reale: ad esempio rappresentare un edificio realmente esistente nell’atto di prendere fuoco, o alterare lo skyline di una città facendola risultare differente da com’è in realtà.

- Generare scene realistiche: realizzare una rappresentazione realistica di un evento inesistente, ad esempio un tornado che si avvicina a una città.

DOS and DON’TS

Come già accennato, non tutti i contenuti generati tramite AI dovranno essere segnalati, specialmente nei contesti clamorosamente irrealistici. Allo stesso modo, i creativi non avranno alcun obbligo di segnalare se abbiano o meno fatto ricorso ad algoritmo di intelligenza artificiale in fase di preproduzione del video, ad esempio nel corso della stesura dello script, nell’organizzazione della production schedule, nel disegno dello storyboard e in ogni caso in tutti quei processi che coinvolgono le resa audiovisiva finale del prodotto.

Non vigerà alcun obbligo di segnalazione nemmeno per i filtri grafici, dunque per interventi di correzione del colore oppure di alterazione generale del look dell’immagine, ad esempio un effetto seppia per conferire un mood antico al video. Non sarà nemmeno necessario segnalare la presenza di sfondi virtuali, ad esempio i background sostituiti a sfondi monocromi tramite alterazioni di chiave. E come già spiegato non sarà necessario segnalare come alterati le commistioni tra realtà e finzione che fanno interagire persone con creature fantastiche o luoghi palesemente virtuali.

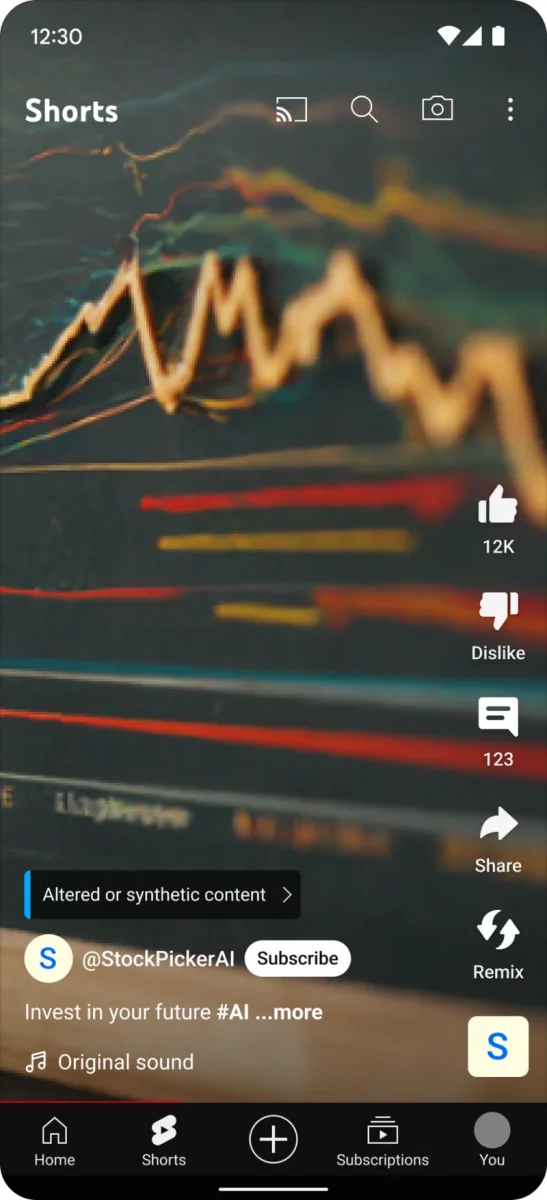

Tale obbligo sarà imposto specialmente riguardo determinante categorie di video che YouTube giudica particolarmente importanti per la sensibilità degli argomenti trattati. Tali categorie sono, ad esempio, Salute, News, Elezioni, Finanza. Per questo tipo di contenuti video, una volta che il creativo avrà etichettato in modo appropriato il video, l’utente vedrà apparire un’etichetta di segnalazione come quello che vedete nell’immagine sovrastante. Da ciò si capisce che tali segnalazioni riguarderanno sia i video canonici sia gli Shorts. Per i video appartenenti ad altre categorie non altrettanto sensibili, invece, la segnalazione sarà limitata al box informativo in calce agli stessi.

L’implementazione del nuovo sistema di segnalazione ed etichettatura sarà implementato a scaglioni nel corso delle prossime settimane. Dunque non passerà molto prima di vedere in azione il nuovo sistema. Sarà interessante testimoniare quanto frequentemente appariranno queste notifiche: avremo così un riscontro concreto della rapidità di diffusione dei contenuti AI-generated all’interno della più grande piattaforma di video sharing del mondo occidentale.